- トップ >

- コラム

1.AIリスクマネジメントフレームワーク (ご参考)

2.人工知能(AI)規制について (ご参考)

3.音声感情解析AI「ALICe」AI規制について (ご参考)

4.感情色「プルチックの感情の輪」(ご参考)

5.メンタルヘルスとは(ご参考)

6.インサイド・ヘッド2の感情達(ご参考)

7.脳波から声を再生 〜 AI克也が登場 〜(ご参考)

8.デスクレスワーカーの音声DX(ご参考)

9.AIエージェントとは(ご参考)

10.シンギュラリティ:技術的特異点とは(ご参考)

11.生成AIにおけるハルシネーション:幻覚とは(ご参考)

12.コンテナ型の仮想化技術(ご参考)

13.文字からでは察せないカスハラ(ご参考)

1.AIリスクマネジメントフレームワーク (ご参考) :2023年12月1日

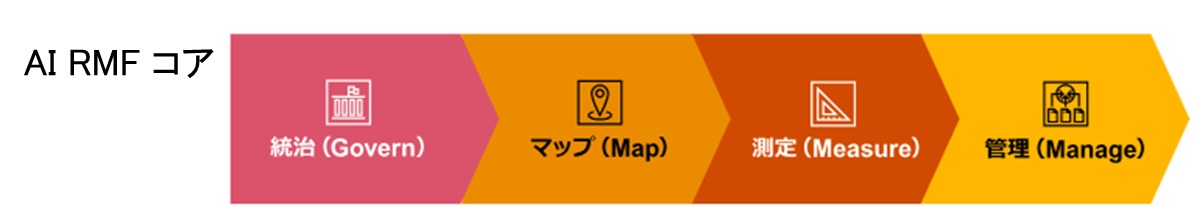

米国商務省の国立標準技術研究所(NIST)は2023年1月、人工知能(AI)技術のリスク管理のためのガイダンスである「AIリスクマネジメントフレームワーク」(AI RMF)を発表しました。

日本の組織にとって非常に有益なドキュメントである「AI RMF」解説を下記の参考・引用文献(サイト)からご参照ください。

[ 参考・引用文献(サイト) ]

PwC Japan 「NIST AIリスクマネジメントフレームワーク」解説

2.人工知能(AI)規制について (ご参考) :2024年9月11日

AIの進歩は社会に新たな利益と、自動化に向けて驚くべき進化をもたらし、あらゆる業界での競争激化が予想されます。

このような流れを受け、欧州連合(EU)では、基本的権利、民主主義、法の支配、環境の持続可能性を保護するため、リスクベースアプローチによる包括的なAI規制法が暫定合意されました。

2024年5月21日に生成AIを含む包括的なAIの規制「EU版AI規制法」が成立、8月1日に発効され、規制内容に応じて2030年12月31日までに段階的に施行されます。

米国の動きとしては、米国コロラド州議会は2024年5月8日、民間部門によるAIの使用を規制するための法案を可決されました。

同法案はAIの潜在的なリスクから消費者を保護することを目的としたもので、知事に署名されれば、民間部門における全米初の州単位のAI規制法となり、2026年2月に施行されることになります。

最後に、日本国内においては、現時点ではAIを包括的に規制する法令は存在しませんが、拘束力のない「AI利活用ガイドライン」が定められています。

[ 参考・引用文献(サイト) ]

総務省 「EUにおけるAI規制と偽・誤情報対策」(PDF)

総務省 「AI利活用ガイドライン」(PDF)

内閣府 「AIを巡る主な論点」(PDF)

3.音声感情解析AI「ALICe」AI規制について (ご参考) :2024年9月18日

ALICeの音声感情認識の演算方法(基本手法)については、欧州連合(EU)で定義するAIシステムの範囲には含まれないと認識しています。

基本手法は、基本エンジン提供先であるNemesysco社が20年以上にわたって使用しているLVA(Layard Voice Analysis)テクノロジーを用いています。

LVAテクノロジーは、専門家が20年以上にわたって細心の注意で分析した専門知識に基づいて感情データを出力しており、人工知能に基づいている訳ではありません。

但し、ALICeにおいて、検出した感情データを用いてどのような場面で活用するかのアドバイスには、AI(音声認識AI、生成AI)を利用しているケースがあります。

アドバイスのAI利用により起こり得るリスクには、総務省「AI利活用ガイドライン」に沿った対応を取っておくことを推奨しています。

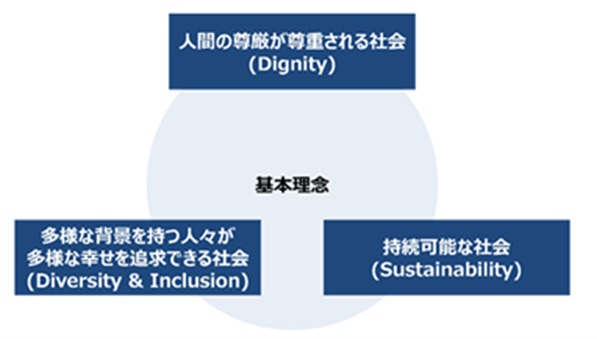

当社のAIガイドラインは、AIの利用がもたらす社会的な影響を考慮し、人間中心の社会の実現を目指しています。

具体的には、人間の尊厳、多様性の尊重、持続可能な社会の実現を基本理念としています。

[ 参考・引用文献(サイト) ]

RHS社 「COLUM No.8」

音声と感情についてPart2 〜AIによる感情検出とAIを使わない感情検出〜

RHS社 「COLUM No.10」

政府公表「AI事業社ガイドライン」に対する当社の対応について

4.感情色「プルチックの感情の輪」(ご参考) :2024年10月24日

読売テレビ「オクトー」感情捜査官 心野朱梨 Season2 が放送中です。

番組内で表現しいる感情色は、「プルチックの感情の輪」アメリカの心理学者であるロバート・プルチック氏が1980年に提唱した理論をベースに映像化してます。

捜査官の朱梨(飯豊まりえ)さんが見えている感情色は、音声感情解析AI「ALICe」を利用した解析においても、人の声から同様な感情色の表現が可能です。

また、音声感情解析AI「ALICe」では、警察の捜査協力要請により、容疑者の証言録音から感情を解析した結果を提出しています。

[ 参考・引用文献(サイト) ]

読売テレビ 「オクトー」感情捜査官 心野朱梨 Season2

読売テレビ 「プルチックの感情の輪」とは

5.メンタルヘルスとは(ご参考) :2024年12月6日

メンタルヘルスとは、体の健康ではなく、心の健康状態を意味します。

「体が軽い」「力が沸いてくる」といった感覚と同じように、「心が軽い」「穏やかな気持ち」「やる気が沸いてくる様な気持ち」の時は、心が健康と言えるでしょう。

しかし、誰でも気持ちが沈んだり、落ち込んだりすることはあります。日々の生活の中でストレスを感じることも少なくありません。

気分が落ち込んだり、ストレスを感じることは自然なことですが、このような気分やストレスが続いてしまうと、心の調子を崩してしまう原因にもなります。

更に心の不調は、周囲の人に気づかれ難く、自分からも伝え辛いため、回復に時間を費やすこともあります。

近年、心の病気は増えていて、生涯を通じて5人に1人が心の病気にかかるとも言われています。

また、音声感情解析AI「ALICe」では、深層感情からストレス・不安などを正確に把握し適切なメンタルヘルスケアを行うサポートツールとしてご利用いただけます。

例えば、業務報告やその日の出来事などを声で入力する仕組みと連携し、声から解析した感情結果(ストレス、不安など)の推移から「心の傾向(健康/不調)」や「心の警告(悲鳴)」など、心の健康状態をAI分析します。

AI分析した心の健康状態を可視化し、本人や関係者(上司・指導者・親類縁者)などに対し伝えることで、本人への従来とは異なる多角的側面から見たフォローが可能になります。

[ 参考・引用文献(サイト) ]

厚生労働省 「メンタルヘルスとは」

RHS社 「メンタルヘルスソリューション」

6.インサイド・ヘッド2の感情達(ご参考) :2025年1月20日

ディズニー&ピクサーの大ヒット作「インサイド・ヘッド」の続編です。本作はケルシー・マン氏が監督を務めています。

あらすじは、思春期を迎えたばかりの主人公「ライリー」の頭の中の世界に新しい「感情」が登場して、司令部が突然壊されました。ヨロコビ、カナシミ、イカリ、ビビリ、ムカムカの5人は、シンパイの登場に困惑しますが、やってきたのはシンパイだけではないようです。

本作の詳細は、ディズニー&ピクサーの下記サイトでご確認ください。

また、音声感情解析AI「ALICe」では、音声から感情達(ヨロコビ、カナシミ、イカリ、・・・)9人毎に感情パラメータを分析して数値化できるので、多角度的なフォローがAI分析で可能になります。

社会の多様化が進む中で、心のケアを行っていくことは最重要課題です。

例えば、音声から心の健康状態の定期的なチェックが可能なツール&サービスです。これにより、予防医学のように心の健康を維持することができるのです。

[ 参考・引用文献(サイト) ]

ディズニー&ピクサー 「インサイド・ヘッド2」

RHS社 「メンタルヘルスソリューション」

7.脳波から声を再生 〜 AI克也が登場 〜(ご参考) :2025年2月18日

■ 脳内の声を読み取る研究

2019年4月、米カリフォルニア大学サンフランシスコ校の研究チームから、イギリスの科学誌「ネイチャー」に下記の興味深い論文が発表されました。

この実験では、BCI(Brain Computer Interface)と呼ばれる脳波等を読み取る装置を着用した被験者が発声し、コンピュータが脳波と同時に、話す時の口や顎の動きもデータ化します。

そして脳波と口の動きのデータをかけ合わせることで、言葉を発さなくとも、口の動きだけで話そうとした内容が合成音声として再生されます。

この研究は初期段階のものですが、近年ではAI技術のディープラーニング(深層学習)などにより、バーチャルヒューマンを実現させています。

■ バーチャルヒューマンのAI技術例

「ベストヒットUSA特番1984年にタイムマシーンSP AI克也」が2024年4月3日に、BS朝日でオンエアされました。

番組のアーカイブ映像とChatGPTを組み合わせ、1980年代の小林克也さんをAIで蘇らせたバーチャルヒューマンとして登場し、本人と共演していました。

不自然さが若干気にはなりましたが、AI技術の進化を感じ入りました。

最後に、音声感情解析AI「ALICe」では、口の動きや脳波のモニタリングではありませんが、発話の分析により外見からでは区別出来ない微妙な感情まで検出する技術を製品化しています。

[ 参考・引用文献(サイト) ]

note社「脳波から音声を認識する」

BS朝日「1984年タイムマシーン・スぺシャル!AI克也が登場!」

8.デスクレスワーカーの音声DX(ご参考) :2025年3月17日

多くの企業がDX(デジタルトランスフォーメーション)の取り組みによってデスクワーカーの業務環境を刷新しています。

一方で、大きな課題となっているのが労働人口の多くを占めるデスクレスワーカーの業務効率化です。

人材不足が加速する中で、現場業務を支える人々の業務生産性・効率性をどのように高めればよいか、その鍵を握るのが「音声DX」によるコミュニケーション手段の刷新ではないでしょうか。

NTTソノリティ株式会社(本社:東京都新宿区、代表取締役社長:坂井 博)と株式会社BONX(本社:東京都中央区、代表取締役:宮坂貴大)が共同開発した音響技術を搭載したデバイスは、単なる通信ツールではなく、現場での働きやすさを加速させる「音声インターフェース」としての1つの解だと思います。

NTTコミュニケーションズ株式会社(本社:東京都千代田区、代表取締役社長:小島 克重)は、次世代グループ通話サービス「BONX WORK」の普及を通じて、現場に新たなコミュニケーションスタイルを実装し、それを起点としたあらゆる現場での業務変革を強力に推進しています。

そこで、音声DXのツールとして音声認識や生成AIに加え、当社の音声感情解析AI「ALICe」を利用することで、労働者の心の健康の保持増進(メンタルヘルス対策)にも役立つでしょう。

[ 参考・引用文献(サイト) ]

日本経済新聞「音声DXで実現するデスクレスワーカーの業務改革」

厚生労働省「職場における心の健康づくり」

RHS社 「メンタルヘルスソリューション」

9.AIエージェントとは(ご参考) :2025年4月7日

AIエージェントとは、自律的に判断・行動し、与えられた目標を達成する人工知能システムで、知的活動を行う技術です。

コンテンツ生成・出力に特化した生成AIとは異なり、 AIエージェントは生成AIの出力を利用して、さらなるアクションを行う点が大きな違いになります。

AIエージェントの活用例は、カスタマーサポート、自動運転、チャットボット、音声アシスタントなど、ユーザーのフィードバックを受けて柔軟にプランを改善し再提案するなどの技術として、幅広い応用分野での活躍が期待されています。

AIエージェントの仕組みは、下図に示すように「知覚」「推論」「行動」「学習」という4つのステップで自律的・能動的に思考して行動します。

継続的な学習機能の効果により、AIエージェントの業務処理は高度化されて、まるで人間のアシスタントのように、働くほどスキルアップしていくわけです。

しかし、AIエージェントを運用するには、正しい学習データの取捨選択と、プライバシー保護とセキュリティ対策などに加え、IT人材の確保が必要となるため、さすがに一足飛びにはいきません。

最後に、AIエージェントの「知覚」に当社の音声感情解析AI「ALICe」を加えることにより、さまざまな感情パターンの「学習」を積み重ねて、あらゆるシーンにおけるユーザーの感情を「推論」して「行動」する、つまり相手の気持ちに寄り添った応待を可能とする、人情味が漂うようなAIエージェントが主流になると提言します。

[ 参考・引用文献(サイト) ]

docomo business 「注目が集まるAIエージェントとは」

10.シンギュラリティ:技術的特異点とは(ご参考) :2025年5月12日

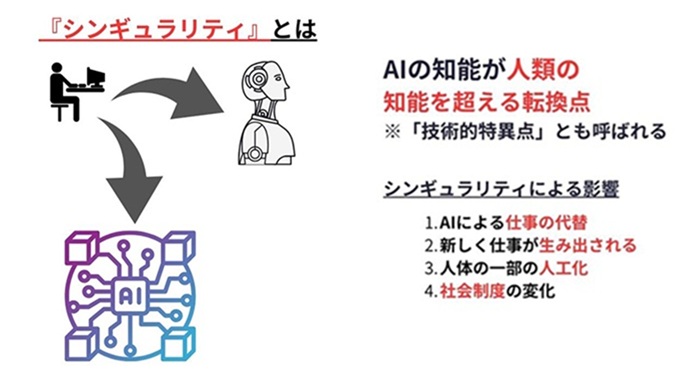

「シンギュラリティ」Singularity(技術的特異点)とは、自律的な人工知能が自己フィードバックによる改良を繰り返すことによって、人間を上回る知性が誕生するといった仮説のことです。

人工知能研究の世界的権威であるレイ・カーツワイル氏が2045年に「シンギュラリティ」に到達すると予測していることから、2045年問題とも呼ばれています。

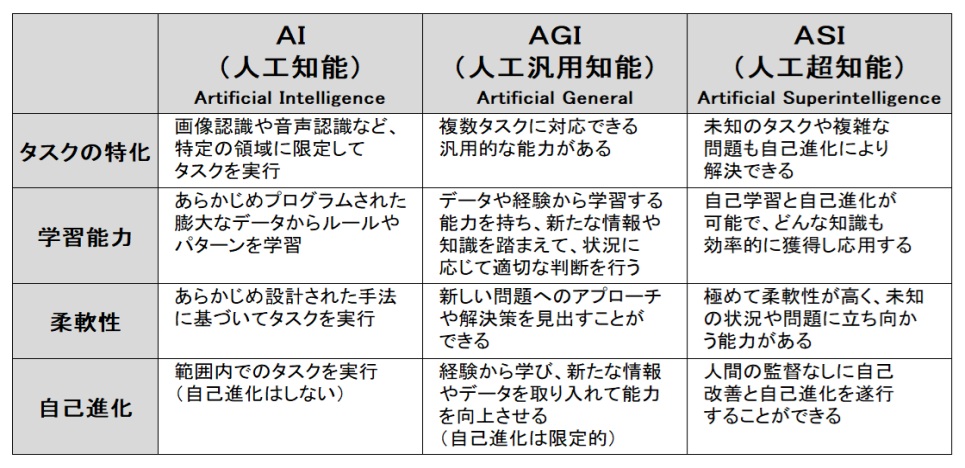

AI技術の進化を示すキーワード、AI(人工知能)→AGI(人工汎用知能)→ASI(人工超知能)の概要と比較表を下記に示します。

従来の「AI」は、特定のタスクや問題に特化したもので、1つのプログラムやアルゴリズムで動作している限定的な範囲での活動が主な技術です。

次世代の「AGI」では、汎用的な知能を持つことで複数のタスクに対応できる、人間のような柔軟性を持つようになります。

更に進化した「ASI」は、人間の知能をはるかに超えるため、未知のタスクも解決できるようになります。

将来、人間の知能をはるかに超えた「ASI」が現れた時に「シンギュラリティ」が起こり、社会はあらゆる面で大きく変化すると言われています。

最後に、当社製品の音声感情解析AI「ALICe」を利用して、あらゆるシーンの会話から「感情情報」、「真偽情報」、「パーソナリティ特性」を判定した結果の活用が「シンギュラリティ」の実現において欠かせないものになると提言します。

[ 参考・引用文献(サイト) ]

ソフトバンク 「AGI(汎用人工知能)とASI(人工超知能)とは?」

docomo business 「シンギュラリティーとは」

マーケトランク 「シンギュラリティとは!」

11.生成AIにおけるハルシネーション:幻覚とは(ご参考) :2025年6月9日

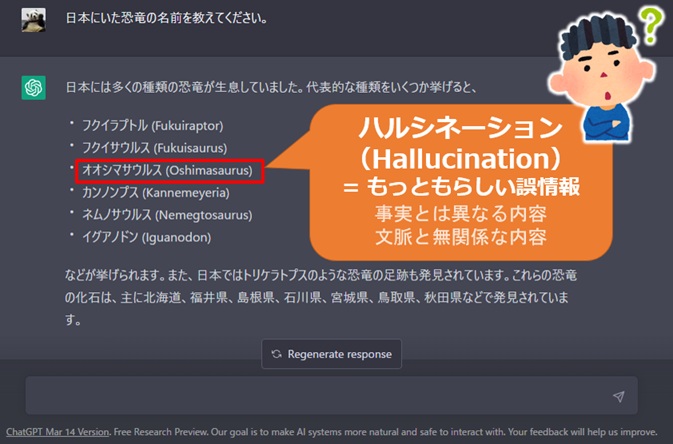

生成AIにおける「ハルシネーション(Hallucination:幻覚)」とは、「事実とは異なる内容」や「文脈と無関係な内容」といった、「もっともらしい誤情報」を提供してしまうことです。

人間が現実の知覚ではなく脳内の想像で「幻覚」を見る現象と同様に、まるでAIが「幻覚」を見て出力しているようなので、このように呼ばれています。

このキーワードは、チャットAI「ChatGPT」などの生成AIが広く使われるようになってから注目されています。

現状の生成AIでは、実際には学習(ディープラーニング)していない情報を、あたかも「幻聴/幻視」しているように、信頼できない出力や誤解を招く出力を生成する場合があります。

例えば、ChatGPTで「日本にいた恐竜の名前を教えてください」と質問したところ、自信満々に「オオシマサウルス」が挙げられたことがあり、これはネット検索してもヒットしないので恐らく「もっともらしい誤情報」の一例だと思われます。

このようにハルシネーションには、AIから返答を受け取った人間が「本当かどうか」の判断に困るという問題が起きてるのです。

ハルシネーションの防止・軽減に向けた対策は、生成AI技術を安全かつ効果的に活用するための基盤を築くうえで非常に重要です。ハルシネーション問題に対する回避策の例を下記に示します。

(1) RAG(Retrieval-Augmented Generation) 検索拡張生成

大規模言語モデル(LLM)に検索機能を組み合わせたAIを利用する手法です。

生成AIによる回答の精度は高まり、さまざまな業務の効率化を促進できます。

(2) Bing検索のチャット機能

Webアクセスを質問に含めることで「もっともらしい誤情報」を軽減しています。

幾つかのサイトを検索した上で質問に回答する機能が搭載されています。

(3) 生成AIによる対処

生成AIに対して「知らない情報」を質問すると、下記の返答が提示されます。

□ OpenAI「ChatGPT」

私が知る限り、○○については情報が得られませんでした。

正確な情報をお伝えできず申し訳ありません。

□ GoogleのチャットAI「Gemini」

私は言語モデルでしかなく、それを処理し理解する能力がないため、

お役に立てません。

生成AIの進化により私たちの生活やビジネスの効率が大幅に向上している中で、ハルシネーションがAI活用の信頼性を左右する深刻な課題として位置づけられています。

しかし、曖昧な質問やAIモデルが未知の分野に関する質問を受けた際に起こりやすく、特に正確性が求められる専門分野については、ハルシネーションの発生頻度が高まる傾向にあります。

そこで、当社製品の音声感情解析AI「ALICe」の音声データ解析との組み合わせで、ハルシネーションの防止・軽減に向けた案をご紹介します。

当社製品の音声感情解析AI「ALICe」では、音声から浮かび上がる被疑者の心理を分析する、警察関連向けの捜査支援ソリューションを提供しています。

現在、世界54か国で導入され50万件以上の捜査を支援しており、一部の国では裁判における証拠資料としての採用実績があります。

日本国内においても、警視庁および各県警本部にて本ツールの活用が始まり、捜査の効率化と精度の向上に貢献しています。

従来の方法では見抜くことが難しかった供述の裏にある感情や信憑性を、音声データを通じて客観的に解析することで、捜査の方向性をより確かなものへと導くことが可能になります。

最後に、当社製品の音声感情解析AI「ALICe」は、上記の導入実績から、真偽判定(音声感情解析ベース)の結果は高い性能を示しており、生成AIとの組み合わせにより、人間の嘘や心情・性格が見抜けることで、誤情報「ハルシネーション」リスクの防止・軽減に貢献し、人情味がある意思決定やサポートを支援します。

[ 参考・引用文献(サイト) ]

ITmedia 「ハルシネーション(Hallucination)とは?」

RHS社 「捜査支援ソリューション」

12.コンテナ型の仮想化技術(ご参考) :2025年9月1日

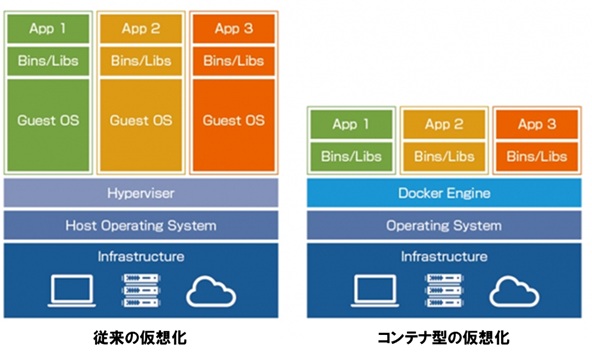

■ コンテナ型の仮想化とは

仮想化技術の1つである「コンテナ型」とは、アプリケーション環境(本体、設定ファイルなど)をコンテナという独立空間で構築する技術のことです。

コンテナは、ホストOS上にインストールされた「コンテナエンジン」によって、運用や管理を行っています。

最大の特徴は、ゲストOSを必要としないことです。コンテナ型の仮想化では、ホストOSから直接それぞれのコンテナを管理することができます。

■ 従来の仮想化とは

仮想化とは、物理サーバのリソースを抽象化することで、リソースを分割して運用する技術です。

アプリケーション毎に物理サーバを必要としないので、ハードウェアのコストを抑え、運用や管理が容易になるなどの多くのメリットがあります。

「従来の仮想化」と「コンテナ型の仮想化」の大きな違いはゲストOSの有無です。

■ コンテナ型の仮想化ツールについて

コンテナ型の仮想化には、主流となる下記2つの代表的なツールが存在します。

・ Docker(ドッカー)

・ Kubernetes(クーバネティス)

「Docker」はコンテナ型の仮想化技術を支えるツールで、「Kubernetes」は複数のコンテナを管理する連携ツールです。各ツールの詳細を下記に示します。

■ コンテナ型の主流「Docker」とは

「Docker」は、コンテナ型の中で最もメジャーで導入実績が豊富なオープンソースの仮想化ソフトウェアです。

環境構築や開発、起動を行うためのプラットフォームであり、2013年にDocker社によって開発・公開されました。

「Docker」は、開発環境設定をコード化して設定ファイルで管理しているので、複数人のローカル開発環境の違いを無くし、同じ条件での開発を可能にします。

また、「Docker」は構築したコンテナをコピーするだけで、開発環境から本番環境へ容易に移行できます。

■ コンテナ管理を容易にする「Kubernetes」とは

コンテナ型の仮想化を使用するケースでコンテナが増えた場合、複数の異なるホスト間でコンテナをやり取りする必要が出てきます。

「Docker」にはコンテナを管理する機能はありませんが、デプロイやスケーリングなどの「Kubernetes」の機能により、複数ホスト間のコンテナを管理します。

障害の発生によってコンテナが停止した場合に自動復旧する機能もあり、作業工数や運用コストを削減します。

■ まとめ

コンテナ型の仮想化のメリットは、動作速度の向上やリソースの消費削減や、環境構築が容易などで、

デメリットは「Docker」や「Kubernetes」などのツール利用で、最小限に抑えられる技術のご紹介でした。

最後に、当社製品の音声感情解析AI「ALICe」 SDKは、Ubuntu(Linux OS)上で動作する「Docker」を採用しています。

声の分析で様々な情報(感情情報、真偽情報、パーソナリティ特性など)を出力した結果を、AI分析で行動指標をご提案する製品です。

コンテナ型の仮想化「Docker」に対応した「ALICe」SDKの導入・運用ノウハウは、製品付属のマニュアルにて詳しく説明しています。

[ 参考・引用文献(サイト) ]

CTC社 「コンテナ型の仮想化を基礎から学ぶ」

東京エレクトロン デバイス社 「Dockerコンテナ」従来の仮想化と何が違うのか

13.文字からでは察せないカスハラ(ご参考) :2026年1月9日

顧客等からの苦情を受ける観点から見ると、「カスタマーハラスメント(以下、カスハラ)」と「クレーム」は同じように見えてしまいます。

しかし「カスハラ」は、顧客等からの暴行・脅迫・ひどい暴言・不当な要求等の著しい迷惑行為のことです。

一方、「クレーム」は商品やサービスに対する顧客等からの正当な改善要求であり、企業に取って貴重な情報源となるもので、両者は明確に識別しなくてはなりません。

当社製品の音声感情解析AI「ALICe」では、音声認識(文字情報)からでは気付けない「カスハラ」の予兆や発生状況(応対苦慮、ストレス上昇、など)を、電話応対の声(音声情報)からリアルタイムに通知します。

「感情解析」から予兆段階で早期に検知し、「真偽判定」で「カスハラ」と「クレーム」を識別することで、適切な応対支援に繋げます。

また、応対者のメンタルヘルスを適切に管理するツールとして活用できます。

パーソナリティ診断(36タイプの性格判定)機能と組み合わせることで、ストレスサインの早期発見(セルフモニタリング)など自発的なメンタルケアを支援します。

■ 予兆検知

重大化する前の予兆段階で「カスハラ」行為を捉え、客観的基準での応対支援(推奨フレーズ、境界線提示、エスカレーション基準、など)を可能にする仕組みをご提供します。

■ 真偽判定

真偽判定アルゴリズムにより、「カスハラ」と「クレーム」の識別と、実際にお困り(お怒り)の顧客等と愉快犯・常習犯を識別する仕組みをご提供します。

■ 感情解析

顧客等の感情状態(怒り・苛立ち、焦り・不安、など)を監視し、応対者の「応対苦慮」「ストレス上昇」などの感情挙動を監視し、「予兆検知」に繋ぐ仕組みをご提供します。

カスハラ対策は、2026年10月1日より施行される改正「労働施策総合推進法」により、すべての企業・事業主の義務となります。

[ 参考・引用文献(サイト) ]

政府広報オンライン(内閣府大臣官房政府広報室)「カスハラとは?」

RHS社 「メンタルヘルスソリューション」